Datos, Privacidad, Vigilancia y Predicciones: la paradoja digital, Vivimos rodeados de tecnología que, mientras nos promete eficiencia y personalización, recolecta silenciosamente nuestros datos, moldea nuestras decisiones y predice nuestros comportamientos. Pero, ¿cuánto entendemos realmente de los intereses ocultos tras las plataformas digitales? Y lo más irónico: esa "inteligencia artificial" tan admirada depende, en última instancia, de nuestro juicio humano para funcionar, cuestionarla... o simplemente aceptarla

¿Subestimamos nuestros teléfonos? ¿O somos nosotros los que los usamos para hacer preguntas como "¿pueden los gatos tener crisis existenciales?" mientras ignoramos su potencial real? No hay manuales claros sobre cómo deberíamos usar estas herramientas, pero claro, se las damos a nuestros hijos confiando en que les ayudarán en su educación... o al menos para que memoricen datos curiosos.

Vivimos en un mundo artificial donde los datos se ven como algo complejo e inalcanzable, lo que nos hace perder la conexión real con la tecnología. Creemos que solo pagando por servicios obtenemos valor, olvidando que en los 90 y hasta el 2000, Internet era una experiencia orgánica: foros donde personas reales compartían ideas y construían comunidades. Hoy, en cambio, la datificación —esa palabra tan inocente— lo convierte todo en números.

Datificación: Cuando Tu Vida se Vuelve un Algoritmo

¿Qué es la datificación? Es tomar cada aspecto de tu realidad y transformarlo en datos:

Tus pasos, tus horas de sueño, tus emociones en redes sociales.

El tiempo que pasas dudando frente al cereal en el supermercado (sí, eso también).

Tus entradas y salidas de casa, registradas por cámaras o relojes inteligentes.

Todo se almacena, se analiza y se usa para predecir tu comportamiento. ¿Suena útil? Sí. ¿Suena un poco a distopía? También.

El Precio de la "Conveniencia"

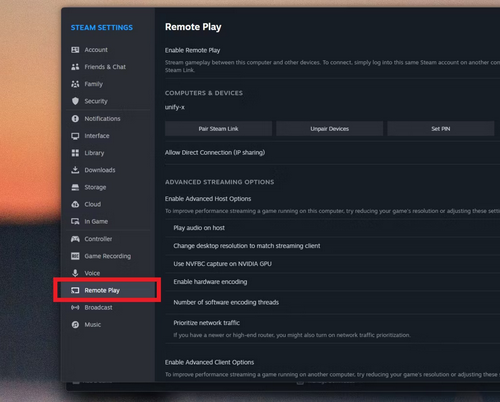

Los sensores y sistemas de captura están en todas partes: GPS, cámaras, wearables, formularios en línea. Hasta tu conexión a redes sociales puede ser monitoreada y "optimizada". ¿La parte curiosa? Pedimos estos dispositivos voluntariamente, sin saber realmente cómo afectan nuestra privacidad o cómo interactúan con nuestra vida.

¿Hacia Dónde Vamos?

Con la agenda 2030 como telón de fondo, estos procesos se aceleran. Se nos vende como progreso, pero ¿a qué costo? Cada vez que aceptamos un término y condición sin leer, cada vez que instalamos una app gratis, estamos alimentando un sistema que nos vigila, nos analiza y, al final, nos predice.

La tecnología no es buena ni mala, pero nuestra ingenuidad podría ser el problema. Quizá sea hora de preguntarnos: ¿realmente controlamos nuestros dispositivos, o son ellos los que nos controlan a nosotros?

La Datificación: Entre el Progreso y esa Sensación Incómoda

Por un lado, tenemos esos maravillosos datos almacenados en servidores, nubes y dispositivos locales: cuántas veces encendiste el televisor, cuántas horas pasaste conectado al Wi-Fi, o incluso cuántas veces mencionaste Netflix en tus conversaciones. Qué práctico, ¿no?

Luego está toda esa información que proviene de los dispositivos IoT, capaz de identificar patrones y correlaciones para crear fascinantes modelos predictivos. ¿Sabías que pueden predecir tus decisiones futuras? Claro, miles de personas ya usan estos datos para monetizar, mejorar servicios, optimizar procesos y personalizar productos. Imagina a tu hijo, de 8 de la mañana a 3 de la tarde, jugando en una plataforma que le paga por sus datos. ¿Lo dejarías? Porque esto ya existe, y ni siquiera hemos llegado a la inteligencia artificial. Pero tranquilos, no corramos.

Sé lo que piensas: "Esto no es relevante, no se ve a gran escala". Pero quizá deberíamos prestar más atención a estos ejemplos que, aunque dan un poco de escalofrío, muchos prefieren ignorar.

El Lado "Brillante" de la Datificación

En salud, los relojes inteligentes registran pasos, ritmo cardíaco y sueño, convirtiendo cada aspecto de tu vida en datos saludables. En educación, Google Classroom mide participación, tiempo de lectura y entrega de tareas, creando un perfil de aprendizaje personalizado (o un informe de cuánto procrastinas). Y en el trabajo remoto, los sistemas monitorean tu productividad para "ayudarte" a no distraerte. Porque nada motiva más que saber que te vigilan.

En el marketing digital, los likes, comentarios y visualizaciones se convierten en datos personalizables para publicidad. Facebook incluso implementó interacciones anónimas, lo que permite analizar cómo se comporta la gente cuando cree que nadie la ve. Qué útil, ¿verdad? Yo trabajo con estos datos, y créeme, son tan reveladores como aterradores. No solo muestran interacciones, sino también qué contenido provoca shock, ira o violencia. ¿Qué podría salir mal?

Big Data o "Gratificación" (Como Algunos Le Llaman)

En las ciudades inteligentes, cámaras de tráfico, sensores de contaminación y registros de transporte generan datos para mejorar movilidad y calidad del aire. Suena bien, hasta que recuerdas que también hay cámaras en el metro y cerca de tu trabajo, convirtiendo cada movimiento en información analizable. ¿Ciencia ficción? Para nada. Es el presente.

Pero, claro, con esto viene la pérdida de privacidad, la vigilancia masiva y el pequeño detalle de que terceros pueden usar mal nuestros datos. ¿El resultado? Aquí estamos, en un mundo donde cada paso queda registrado, pero al menos el aire está un poco más limpio.

Sé que suena un poco oscuro hablar de esto, pero los datos están ahí, respaldados por libros clave que abordan la relación entre inteligencia artificial, datos masivos y sus implicaciones éticas. Empresas de ciencia y tecnología los organizan, los estudian y, oh sorpresa, los usan a diario. Puede parecer extraño, pero autores como Rob Kitchin ya hablan de la datificación, el open data y las infraestructuras ocultas detrás de todo esto.

Su libro explora los fundamentos del big data y cómo estos datos se han convertido en el núcleo de la sociedad contemporánea. Conceptos como la datificación (o "gratificación", como algunos le llaman) y las infraestructuras de datos están transformando todo: la política, la economía, la vida social e incluso lo que desayunamos. Los desafíos éticos, legales y técnicos son enormes, pero claro, seguimos adelante como si nada.

Si quieres entender más, quizá no deberías quedarte aquí. Porque no vamos a caer en chismes o información de baja calidad como hace la competencia. Esto no es nota roja, es realidad.

Cuando Intentas Explicarlo y la Gente No Entiende (O No Quiere)

Expuse esta información a un grupo de personas socialmente estables (o eso creía), preguntándoles sobre algoritmos y datificación injusta. Sus respuestas fueron... interesantes. Preguntas no tan inteligentes, desconexión total. ¿Por qué? Porque es un tema que, aunque nos afecta a todos, sigue siendo invisible para muchos.

Y esto ha sido clave en los últimos años: la tecnología no solo ha cambiado cómo nos relacionamos con los datos, sino también cómo nos relacionamos entre nosotros. ¿Cuánto tiempo real tenemos para descansar? ¿O para compartir con la familia? Los trabajos, combinados con estos modelos algorítmicos, están redefiniendo nuestra vida diaria, aunque no nos demos cuenta.

El Libro que Lo Explica (Y Asusta un Poco)

En "Weapons of Math Destruction", Cathy O'Neil expone cómo el big data aumenta la desigualdad y amenaza la democracia. Habla de cómo estos modelos algorítmicos afectan áreas clave:

Educación: ¿Quién decide qué alumnos "tienen potencial"?

Empleo: ¿Eres eficiente o solo estás atrapado en un ciclo de trabajo "relajado" pero controlado?

Justicia y banca: ¿Quién define tu score crediticio o tu riesgo de reincidencia?

Lo peor es que estos sistemas no son transparentes. Se usan cada vez más en plataformas digitales, y nosotros perdemos el control. ¿El resultado? Un mundo donde los algoritmos deciden, y las personas ni siquiera lo saben.

"Así que, en teoría, el encanto del trabajo moderno obliga a las personas a realizar acciones centradas en pagos forzados para 'mejorar' su calidad de vida. Qué poético. Estos métodos, expuestos mediante datos tan convincentes como manipulados, promueven el trabajo extremo y la identificación exclusiva con los 'futuros brillantes' de la IA. Por supuesto, todo esto motiva a los usuarios a interactuar con máquinas que, convenientemente, les dicen qué hacer, liberándolos de la tediosa carga de pensar. Así evitan que se les ocurra buscar un empleo mejor, mientras se les cuantifica hasta el último segundo de productividad. Porque nada dice 'bienestar económico y personal' como un sistema diseñado para que no descanses, pero te sientas agradecido por hacerlo en un lugar 'innovador'.

En el lado 'radical' de estas ideologías, hay libros que exponen desigualdades sociales, aunque, claro, siempre podemos distraernos buscando las palabras clave correctas para ignorar las consecuencias éticas. Pero no todo es distopía: también están las cámaras de vigilancia, que —qué alivio— cuantifican nuestra seguridad mientras optimizan el flujo de personal. ¡Qué noble contribución de la IA!

En Hello World: How to Be Human in the Age of Algorithms, Hannah Fry explica —con delicioso sarcasmo— cómo hemos perdido la cabeza entre tecnicismos. La medicina, la justicia, las finanzas... incluso las citas amorosas ahora son reducibles a datos. Porque nada dice 'amor verdadero' como un algoritmo prediciendo tu compatibilidad. Eso sí, hace la vida más 'profunda', 'mórbida' y, sobre todo, más entretenida... para quienes miran desde afuera, claro."

Sé que puede sonar un poco oscuro promover este tipo de información, ya que hay muchos datos evidentes que se pueden encontrar en libros clave que abordan las relaciones entre la inteligencia artificial, los datos masivos y sus implicaciones éticas y sociales. Este tipo de temas suelen ser organizados y analizados por empresas dedicadas a la ciencia y la tecnología. Y sí, sé que puede parecer algo extraño, pero existen muchos libros —en especial algunos como los de Rob Kitchin— que hablan sobre la datificación de la sociedad, el uso de datos abiertos (open data) y sus consecuencias.

Uno de estos libros analiza los fundamentos del big data y realmente resulta impresionante, ya que ofrece una visión integral de cómo los datos han pasado a ocupar un lugar central en la sociedad contemporánea. Explica conceptos como la datificación, el big data y la infraestructura de datos, así como su impacto en la política, la economía, la vida social e incluso en aspectos cotidianos como lo que comemos o desayunamos.

Estos cambios han generado una serie de desafíos éticos, legales y técnicos relacionados con el uso masivo de datos. Si estás interesado en comprender más sobre esta clase de información, entonces sigue leyendo. Pero si esperas contenido superficial, basado en chismes o en información de baja calidad generada solo para crear polémica, esta página no es para ti.

Si llegaste hasta aquí y piensas que esto no es importante, recuerda que no estamos tan alejados de este tipo de realidades. Lo que se discute aquí tiene implicaciones directas en el mundo en que vivimos.

Yo expuse esta información a un grupo de personas socialmente estables para preguntarle acerca de este tipo de crítica de los algoritmos y la ratificación injusta el cual empezaron a preguntar cosas muy extrañas y hacer preguntas no tan inteligentes porque pues se desconoce completamente el tema.

Y esto qué ha sido parte fundamental de estos años mezclado con la tecnología ha vuelto que la gente también se deje de juntar este tipo de información no solamente habla acerca de todos estos datos y de la maldad que se empieza a utilizar con estos datos sino que también te has dado cuenta que tanto tiempo nosotros tenemos para poder descansar o qué tanto tiempo nosotros creemos que tenemos para poder compartir con nuestra familia o el simple hecho de los trabajos en este tipo de información y de combinación de estos datos pueden hacer que tenga un modelo algorítmico y afecten directamente la vida diaria..

Weapons of Math Destruction: How Big Data Increases Inequality and Threatens Democracy

Autora: Cathy O’Neil

Publicado: 2016

En el libro titulado Weapons of Math Destruction, Cathy O'Neil expone cómo el uso irresponsable del big data no solo afecta la calidad de vida de las personas, sino que también perpetúa desigualdades y pone en riesgo la democracia. La autora analiza cómo ciertos algoritmos, aparentemente neutrales, en realidad refuerzan sesgos estructurales y producen consecuencias negativas a gran escala, especialmente para las poblaciones más vulnerables.

Cathy O’Neil, matemática y ex científica de datos en Wall Street, plantea una crítica directa al uso descontrolado de algoritmos en áreas como:

- Educación (evaluación de maestros y rendimiento estudiantil)

- Finanzas (créditos, seguros, puntajes de riesgo)

- Empleo (reclutamiento automatizado, despidos)

- Justicia penal (algoritmos de predicción de reincidencia)

Ella introduce el concepto de "armas de destrucción matemática" (Weapons of Math Destruction o WMDs), que son modelos algorítmicos:

- Opacos: No es posible entender cómo funcionan ni auditarlos.

- No regulados: Operan sin rendir cuentas.

- Escalables: Se aplican a millones de personas.

- Dañosos: Amplifican la desigualdad y la discriminación

Cuál afecta directamente la vida diaria como en partes de la educación el empleo la justicia y la banca en el empleo expone como este tipo de modelos algorítmicos se basan directamente en la presión para hacer que las personas trabajen de una manera no forzada pero sí eficiente lejos de ser un objetivo claro de su trabajo o obligarlo a sentirlo hacerlo sentir que pertenece a un ciclo de trabajo de control muy relajado el cual no solamente afecta a las personas que trabajan o que sufren de overboarning sino que también la transparencia y el control de esta información se ha empezado a utilizar con mayor frecuencia en especialmente en estas plataformas digitales donde ahora ya no podemos tener el control de todas las cosas por interés

Porque, claro, la datificación no se limita a contar cuántas veces desbloqueas tu celular o cuántos videos de gatos miras en una tarde. Eso sería demasiado simple. Lo verdaderamente fascinante —si por 'fascinante' entendemos 'ligeramente aterrador'— es cómo este sistema orquesta nuestra vida diaria. Por ejemplo, si un algoritmo decide que, por cada hora que pasas en tu dispositivo, solo mereces 20 minutos de vida real, ¿quién eres tú para cuestionarlo? Especialmente cuando ya hemos entrenado a los niños desde los 7 años para que exijan pantallas en lugar de atención. Nada dice 'crianza saludable' como un iPad como niñera digital, liberando a los padres para que puedan… bueno, desplomarse en el sofá y ver algo en su pantalla. Qué círculo virtuoso.

Pero no te preocupes, todo esto se discute en libros muy serios, porque, obviamente, la información diaria no solo debe ser 'divertida', sino también 'entretenida'. Y qué mejor entretenimiento que ver cómo los algoritmos moldean las mentes de los más pequeños, redefiniendo el núcleo familiar con la sutileza de un martillo. Porque, en este mundo moderno, hemos decidido creer —contra toda evidencia— que más tecnología automáticamente nos hace mejores personas. Spoiler: no está funcionando.

Para alguien con dos dedos de frente, estos datos son alarmantes. Para un experto en seguridad informática, son una mina de oro de vulnerabilidades. Pero, como esto ya empieza a sonar como el prólogo de una distopía cyberpunk, mejor dejémoslo aquí… y pasemos a otro libro.

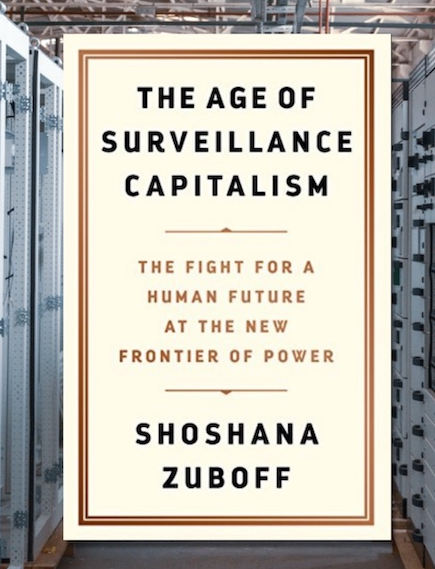

Uno de los conceptos más inquietantes —y extrañamente normalizados— es ese "capitalismo de vigilancia" del que habla Shoshana Zuboff. Porque, claro, ¿qué podría ser más encantador que empresas tecnológicas convirtiendo cada clic, cada video absurdo que miras, incluso cada suspiro de aburrimiento frente a la pantalla, en un producto vendible? No se trata solo de que hayan monetizado tu privacidad, sino de que han creado un nuevo modelo de poder donde tú, querido usuario, eres el recurso natural. Y lo mejor: ni siquiera te pagan por ello.

Zuboff no solo advierte sobre la pérdida de autonomía en esta era de "datificación total", sino que expone cómo el sistema está diseñado para que, cuanto más consumes, más te aferres a la ilusión de control. ¿Te sientes solo? Aquí tienes un algoritmo que te sugiere amigos (o algo parecido). ¿Necesitas validación? Aquí tienes likes, aunque sean de bots. ¿Quieres informarte? Bueno, aquí tienes noticias... bueno, "noticias", cuidadosamente seleccionadas para que no cuestiones demasiado. Qué práctico.

Pero el verdadero chef's kiss de este negocio es cómo estos datos distorsionan la democracia. Las plataformas no solo venden tu atención al mejor postor, sino que pueden moldearla para beneficiar a ciertos partidos, economías o, digamos, "narrativas convenientes". El escándalo de Cambridge Analytica fue solo el aperitivo. Hoy, el big data se usa para todo, desde campañas políticas hasta manipular mercados, todo envuelto en el brillante papel celofán de la "innovación". ¿El resultado? Una sociedad que confía más en su teléfono que en las personas a su alrededor, mientras las empresas celebran con champagne sus ganancias récord.

La Paradoja del Bienestar Digital: Cuando la "Tranquilidad" es solo otra Distracción

Claro, no todo es malo. Los videojuegos nos relajan, las redes nos entretienen, y ese café de 95 pesos nos da una fugaz ilusión de estatus. Qué alivio, ¿no? Excepto que, mientras nos perdemos en mundos virtuales y pequeñas gratificaciones instantáneas, algo curioso pasa: dejamos de entender por qué nos sentimos vacíos. La depresión y la ansiedad se normalizan, como si fueran simples efectos secundarios de "estar conectados". Pero no, no es normal. Es el síntoma de un sistema que nos vende bienestar mientras erosiona nuestras conexiones reales.

Lo más irónico es cómo esta datificación magnifica las desigualdades. Las personas en situación vulnerable no solo cargan con problemas económicos, sino con la presión de aparentar que no los tienen. Las redes convierten la pobreza en un estigma algorítmico: si no puedes permitirte ese café de lujo, el algoritmo te empuja a un rincón digital donde solo ves lo que te falta. Y así, la exclusión se vuelve invisible, pero omnipresente.

La psicología ya lo advierte: la comparación constante, alimentada por el marketing digital y la publicidad hiperpersonalizada, nos encierra en ciclos de insatisfacción. ¿La paradoja? Que la misma tecnología que nos prometió acercar al mundo ahora nos segrega en burbujas de datos, donde los privilegiados ven solo éxito y los vulnerables, solo carencias. La IA no es neutral; refleja (y amplifica) las divisiones que ya existían. Pero hey, al menos tenemos likes para tapar el silencio.

Artificial Intelligence: A Guide for Thinking Humans" – Cuando la IA nos obliga a repensar (y defender) nuestra humanidad

Melanie Mitchell, en su libro Artificial Intelligence: A Guide for Thinking Humans, nos recuerda algo incómodo: la inteligencia artificial no es solo una herramienta, sino un espejo que refleja nuestros propios límites. Y vaya si son reveladores. La obsesión actual con la "datificación" como fuente de verdad absoluta —desde diagnósticos médicos hasta decisiones judiciales— nos lleva a un peligroso territorio donde confundimos procesamiento con comprensión. Spoiler: las máquinas hacen lo primero. Nosotros deberíamos hacer lo segundo.

Mitchell expone cómo, en nuestra carrera por delegar todo a los algoritmos, hemos empezado a subestimar habilidades humanas como el juicio contextual, la intuición o incluso el simple sentido común. ¿El resultado? Un mundo donde valoramos más la velocidad de un dato que la profundidad de un pensamiento. La ironía, claro, es que la IA depende de nuestros sesgos para "aprender", mientras nosotros olvidamos cómo cuestionarlos.

Pero no todo es pesimismo. El libro plantea una resistencia silenciosa: organizarnos para usar la tecnología sin renunciar a nuestro criterio. Porque al final, el verdadero peligro no es que la IA sea "más lista" que nosotros, sino que nosotros mismos dejemos de ser humanos pensantes. Y eso, amigos, sería el fracaso más absurdo de todos: perder nuestra esencia por culpa de las mismas máquinas que diseñamos para imitarla.

La IA y la Paradoja de la "Evolución" Humana: Cuando la Tecnología Nos Hace Menos Humanos

Melanie Mitchell nos plantea una pregunta incómoda: ¿realmente estamos evolucionando con la inteligencia artificial, o simplemente nos estamos volviendo más dependientes de una ilusión de progreso? Porque, claro, nada dice "avance humano" como delegar nuestras conversaciones, decisiones e incluso emociones a algoritmos que, en el fondo, solo repiten patrones de datos. La ironía es palpable: mientras celebramos lo "únicos" que somos, renunciamos voluntariamente a las mismas capacidades que nos definen —empatía, creatividad, criterio— porque una máquina nos promete hacerlo "mejor".

El verdadero peligro no es que la IA tenga límites (los tiene, y muchos), sino que nosotros sobrevaloremos sus capacidades hasta el punto de subestimar las nuestras. ¿Para qué esforzarte en tener una conversación incómoda con un amigo si ChatGPT puede redactarte un mensaje "perfecto"? ¿Para qué desarrollar paciencia o tolerancia a la frustración si un algoritmo puede darte respuestas instantáneas? La tecnología no nos está haciendo más inteligentes; nos está haciendo más cómodos, y en el proceso, más frágiles.

Pero lo más preocupante es cómo esto distorsiona nuestras relaciones sociales. La beatificación de la IA —esa fe casi religiosa en que resolverá todo— nos ha llevado a un mundo donde valoramos más la posesión del "mejor dispositivo" que la capacidad de conectar con otro ser humano. La psicología ya ve las consecuencias: aislamiento, ansiedad comparativa, una generación que prefiere el feedback predecible de una pantalla al caos hermoso de una interacción real. Y no, no es casualidad. Las empresas tecnológicas se benefician de esta dinámica, vendiéndonos la idea de que sin sus productos, somos insuficientes.

Al final, el gran mito no es que la IA nos supere, sino que nosotros mismos nos convirtamos en versiones empobrecidas de lo que podríamos ser. Porque una máquina nunca tendrá que lidiar con el dolor de un corazón roto, la alegría de un logro inesperado o la complejidad de una mirada sincera. Pero nosotros sí. Y si olvidamos eso, no habrá algoritmo capaz de salvarnos.

Parece que hemos llegado a un punto en el que la palabra "revolución tecnológica" es sinónimo de "autodestrucción disfrazada de progreso". Las empresas producen montañas de dispositivos, ropa desechable y comida empaquetada en plástico, como si los humanos fuéramos un estorbo en su cadena de producción perfecta. Todo se reduce a datos: cuánto consumes, cuándo lo haces, cómo reaccionas. Y lo más irónico es que llamamos a esto "innovación", cuando en realidad es la rendición más cobarde de nuestra autonomía.

La inteligencia artificial no es una entidad independiente; está alimentada por nuestra propia pereza, nuestra obsesión por la inmediatez y nuestro miedo a pensar. La datificación masiva no solo transforma industrias y gobiernos, sino que redefine qué significa ser humano. Ya no tomamos decisiones filosóficas o prácticas: las delegamos. Ya no leemos libros; los resumimos con IA. Ya no cometemos errores y aprendemos de ellos; los evitamos con algoritmos que nos dicen qué hacer. ¿El resultado? Una sociedad de zombis digitales, incapaces de discernir entre lo verdadero y lo conveniente, entre lo importante y lo que solo parece serlo porque un algoritmo lo priorizó.

Y no, esto no es una distopía futura. Ya está aquí. Los profesionales en seguridad informática (y cualquiera que aún conserve algo de pensamiento crítico) se ven obligados a luchar contra una marea de automatización absurda, donde lo "eficiente" triunfa sobre lo humano. Pero lo verdaderamente aterrador no es que la IA avance, sino que nosotros retrocedamos. Que prefiramos un resumen generado por máquina a la experiencia imperfecta pero genuina de leer, equivocarnos y entender. Que valoremos más la velocidad que la veracidad.

Así que, sí, la inteligencia artificial seguirá creciendo, pero la pregunta real es: ¿nosotros seguiremos encogiéndonos? Porque prepararse para esto no es cuestión de escribir papers o consumir contenido vacío. Es decidir si queremos seguir siendo humanos… o solo otra variable en un sistema que ya ni siquiera nos necesita para funcionar.

Si alguien cree que este análisis fue generado por inteligencia artificial o que carece de fundamento real sobre cómo está evolucionando nuestra relación con la tecnología, se equivoca. Esto no es un discurso prefabricado sobre capitalismo ni un ataque ideológico disfrazado. Son observaciones escritas manualmente, basadas en mi experiencia directa y en lo que veo a diario al interactuar con mi entorno.

Vivimos en una era donde todo parece automatizado, donde uno podría pensar que hasta las reflexiones más personales salen de un algoritmo. Pero no es mi caso. Escribo esto conscientemente, con pleno uso de mi criterio, porque me importa hablar de cómo estas herramientas están reconfigurando nuestro día a día.

Hay una ironía difícil de ignorar: pagamos por servicios digitales que nos hacen sentir "conectados" e "incluidos" en este mundo moderno, pero al mismo tiempo, esa misma tecnología nos distancia de interacciones genuinas. Lo veo en mi círculo, en la calle, en cómo la gente prioriza la gratificación inmediata de un like sobre una conversación cara a cara.

No soy un teórico ni un activista. Solo alguien que nota cómo, detrás de la fachada de progreso, hay un desgaste silencioso en cómo nos relacionamos, pensamos y hasta en cómo nos valoramos. Y eso, por más incómodo que sea discutirlo, es algo que está pasando aquí y ahora. No en un futuro distópico, sino en nuestro presente.

Si esto suena crudo, es porque lo es. Pero es la realidad que observo, no un guión generado por IA para impresionar a nadie.

Comments